Clyravision

Bilder sind Unternehmensressourcen, die geschützt werden müssen

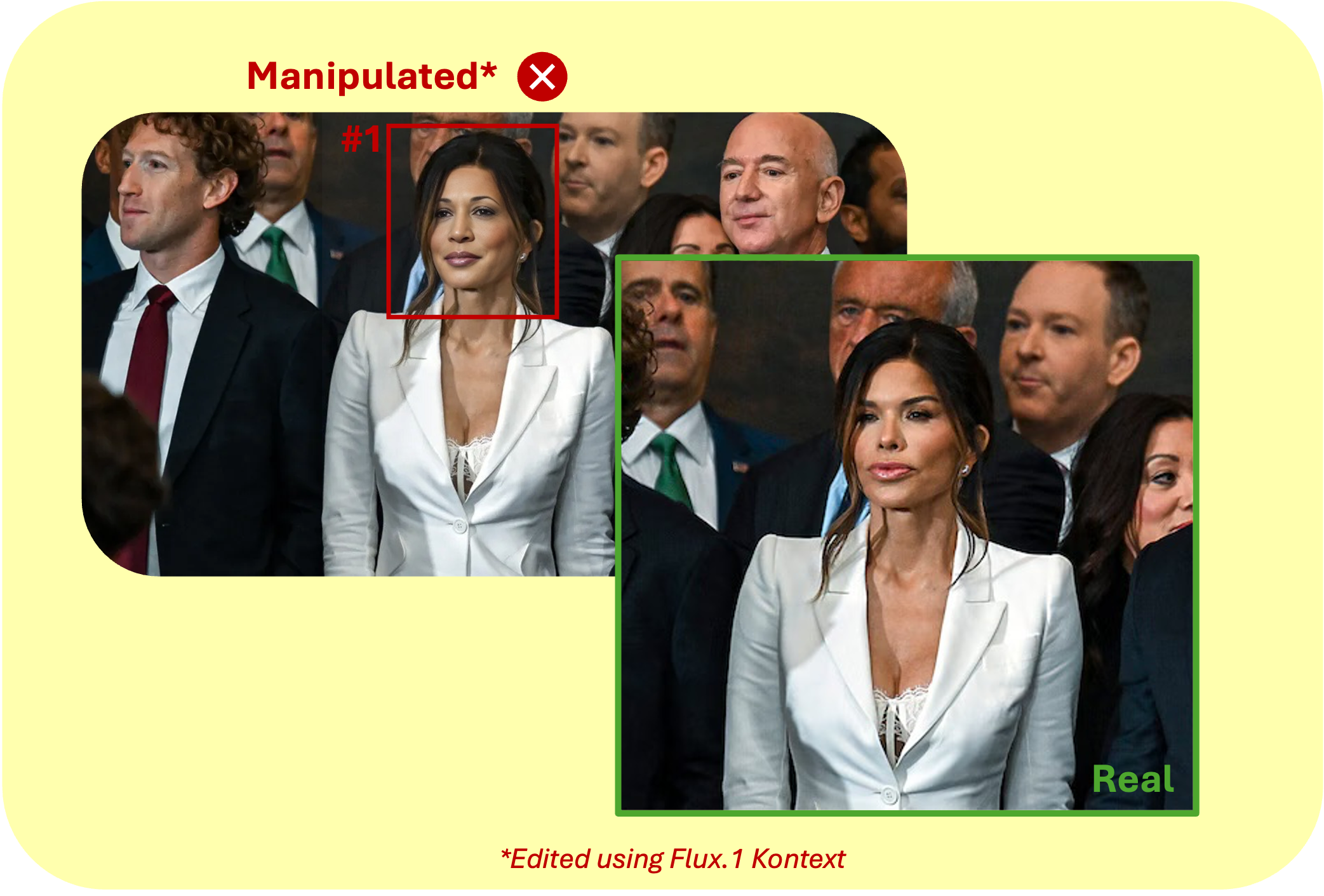

Durch den rasanten Aufstieg von Deepfake-Tools kann heute jeder in wenigen Sekunden realistische, aber manipulierte Bilder oder Dokumente erstellen. Die damit einhergehende explosionsartige Zunahme hochprofessioneller Fälschungen gefährdet die Vertrauenswürdigkeit visueller Daten insgesamt. Unternehmen verlassen sich beispielsweise auf Fotos als Grundlage für finanzielle und operative Entscheidungen mit hohem Risiko. Ein manipuliertes Foto eines Autounfalls, ein gefälschtes Bild eines Produktdefekts oder ein echtes Bild in einem falschen Kontext kann zu erheblichem Betrug, finanziellen Verlusten und Sicherheitsrisiken führen.

Clyravision ist ein Bildforensik-Tool, das auf agentenbasierten Workflows basiert und nachbildet, wie Menschen Bilder analysieren.

Erkennt die Anzeichen

Clyravision sucht nach einer Vielzahl von Manipulationstechniken und erkennt Indikatoren wie KI-generierte Inhalte, Face Swaps und manuelle Bearbeitungen. Es identifiziert auch logische bzw. kontextuelle Inkonsistenzen, sowie technische Hinweise, die in den Metadaten verborgen sind. Dies bietet einen umfassenden Überblick über die Integrität des Inhalts.

Sie behalten die Kontrolle

Unsere Plattform agiert als Co-Pilot, nicht als Black Box, und präsentiert alle technischen Ergebnisse und kontextuellen Daten in einem klaren Bericht. Damit sind Nutzer:innen befähigt, letztendlich die endgültige Entscheidung treffen.

Beweisbasierte Analyse

Das Clyravision-Dashboard bündelt ein Spektrum an Analysen. Es ermöglicht, tiefe forensische Spuren wie Pixelrauschen mit übergeordneten Herkunftsprüfungen (Provenance Checks) und Geolokalisierungshinweisen abzugleichen. Das User Interface integriert auch Trendabgleiche und Ergebnisse der inversen Bildsuche (Reverse Image Search) um ein vollständiges Bild der Analyse zu bekomen.

Kontextbewusste Prüfungen

Mit unserer Bildersuche können Nutzer:innen nachvollziehen, wo und wann ein Bild erschienen ist, und das begleitende Narrativ (was darüber gesagt wurde) verstehen. Dieser Kontext ist entscheidend, um authentische Bilder zu identifizieren, die auf eine neue, irreführende Weise verwendet werden.

Entwickelt für Vertrauen

Unsere Plattform wurde für professionelle Teams entwickelt und unterstützt kollaborative und transparente Workflows. Jede Anfrage und jedes Ergebnis kann protokolliert werden, wodurch der gesamte Analyseprozess vollständig auditierbar ist.

Flexibel und anpassbar

Wir passen uns den individuellen technischen Herausforderungen und Sicherheitsanforderungen an. Wir bieten datenschutzkonforme Self-Hosted-Optionen, um sensible Daten in-house zu halten. Für umfangreiche Workflows kann unsere robuste API große Bildmengen automatisch verarbeiten und sich direkt in Ihre Compliance-Workflows mit hohem Volumen integrieren.

Versicherung

Der typische Schadenprozess in der Versicherungsbranche basiert auf eingereichten Fotos. Die Auszahlung und damit die Abwehr von Betrug hängt direkt von der Echtheit dieser Bildnachweise ab. Durch generative KI, können Schäden komplett erfunden oder verstärkt werden.

Automatisierte Triage: Clyravision scannt alle Einreichungen auf eindeutige Betrugsindikatoren. Dazu gehören digitale Manipulationen zur Erstellung und Vergrößerung von Schäden ebenso wie die Wiederverwendung von Online-Fotos fremder Unfälle.

Human-in-the-Loop: Legitime Ansprüche können automatisch und schneller genehmigt werden. Nur die hochriskanten oder verdächtigen Bilder werden an einen menschlichen Sachbearbeiter weitergeleitet. Dieser kann über das User Interface die detaillierten Beweise (forensische Spuren, Reverse-Image-Search-Ergebnisse) prüfen und eine fundierte Entscheidung treffen.

E-Commerce

Auf E-Commerce Plattformen werden wöchentlich hunderte Garantieansprüche bearbeitet, die häufig Fotobeweise des Mangels erfordern. Die manuelle Prüfung wird schnell zum Engpass, was die Kundenzufriedenheit senkt und die Bearbeitungskosten erhöht. Darüber hinaus ist durch die aktuellen Verbesserungen von generativer KI ein manipuliertes Bild von einem echten mit bloßem Auge nicht mehr zu unterscheiden.

High-Volume Batch Processing: Das System verarbeitet große Mengen und prüft alle Einsendungen auf heruntergeladene Internetfotos, Hinweise auf gefälschte Schäden (z. B. hinzugefügte Risse) oder andere Inkonsistenzen.

Effiziente Entscheidungen: Legitime Ansprüche können innerhalb weniger Minuten genehmigt werden. Verdächtige Ansprüche werden automatisch markiert und in die Warteschlange eines Support-Mitarbeiters geleitet, der über die UI genau sehen kann, warum das Bild als verdächtig eingestuft wurde, bevor er den Kunden kontaktiert.

Nachrichten, Medien & öffentliche Sicherheit

Nachrichtenorganisationen, NGOs oder Krisenstäbe werden bei Großereignissen (z.B. Naturkatastrophen, Protesten) mit Bildern aus sozialen Medien überflutet. Dieses Material kann alt, aus dem Kontext gerissen, manipuliert oder KI-generiert sein, um gezielt Desinformation zu streuen. Die manuelle Verifizierung ist langsam, bindet wertvolle Ressourcen und wird aufgrund der stetigen Verbesserung von generativer KI immer schwieriger.

Automatisierte Authentizitätsanalyse: Das agentenbasierte System ist auf die Verarbeitung vieler Daten in Echtzeit ausgelegt und lässt sich in bestehende Systeme integrieren.

Vielschichtiger Verifikationsworkflow: Prüft Bilder nicht nur auf forensische Spuren digitaler Veränderungen, sondern führt auch eine Reverse-Image-Suche durch, um den Ursprung des Bildes und den Kontext früherer Verwendungen zu überprüfen.

Entwicklung ethischer KI-Software

Wir bei Merantix Momentum glauben, dass KI eine Technologie ist, mit der wir viele der heutigen und zukünftigen Herausforderungen für Menschen, Unternehmen und die Gesellschaft angehen und lösen können. Wir sind davon überzeugt, dass die Vorteile von KI für jeden zugänglich sein sollten. Es reicht jedoch nicht aus, nur die technologischen Fähigkeiten bereitzustellen, sondern auch die Verantwortung zu übernehmen, dafür zu sorgen, dass KI für alle sicher und integrativ ist.

Agentische Workflows in der Bildforensik & Deepfake-Erkennung | Clyravision Live-Demo

Unsere Projekte im Bereich Pharma und Gesundheitswesen

Kontaktieren Sie uns

- Fokus auf Forschung mit tabellarischen und Zeitreihendaten

- Lösungen für industrielle Herausforderungen von heute und morgen

- Integration von Machine Learning in etablierte und neue Systeme

- Langjähriger, verlässlicher Partner in öffentlicher und privater Konsortialforschung